Xu hướng camera trong tương lai: từ “nhìn thấy” đến “hiểu và hành động”

Trong nhiều năm, khi nói đến camera, phần lớn chúng ta mặc định nghĩ đến thiết bị ghi hình: ghi lại hình ảnh, video, lưu trữ hoặc truyền đi. Nhưng bước sang kỷ nguyên AI và tự động hóa, camera đang trải qua một sự dịch chuyển căn bản về vai trò: từ cảm biến thụ động sang bộ phận ra quyết định chủ động của hệ thống thông minh.

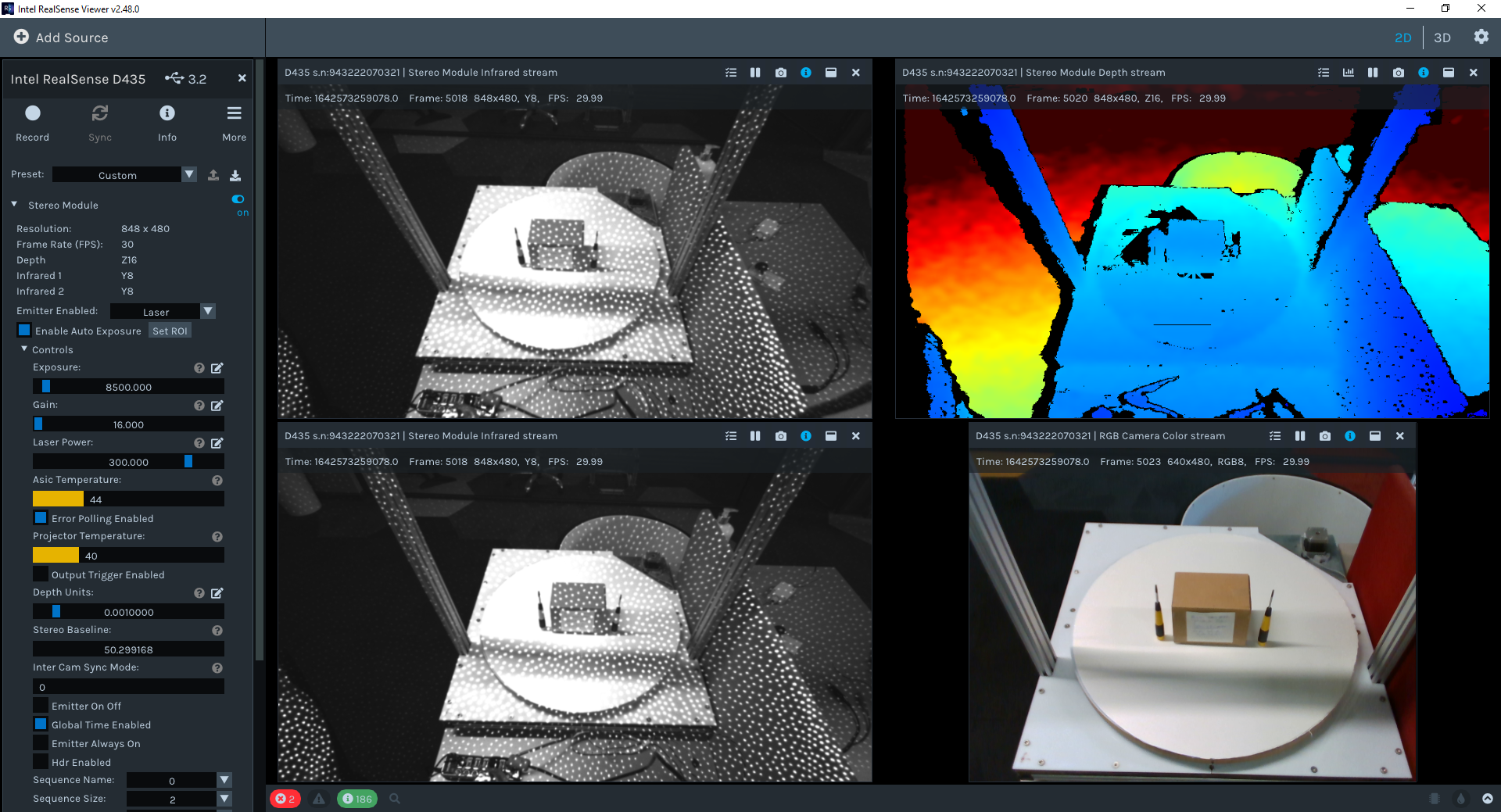

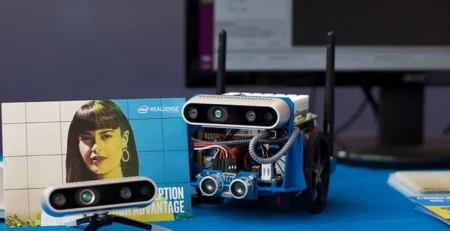

Ở trung tâm của sự dịch chuyển đó là các công nghệ depth sensing và 3D vision, mà tiêu biểu là dòng camera RealSense của Intel.

Camera trong tương lai không còn là “mắt”, mà là “nhận thức”

Nếu nhìn lại 10–15 năm trước, camera chủ yếu phục vụ con người: CCTV để giám sát, camera điện thoại để chụp ảnh, camera công nghiệp để kiểm tra lỗi. AI, nếu có, thường nằm ở tầng cloud, xử lý sau.

Xu hướng hiện tại – và rõ ràng hơn trong 5–10 năm tới – là camera trở thành một phần của hệ thần kinh của máy móc.

Điều này thể hiện qua ba chuyển dịch lớn:

-

Từ 2D sang 3D (Depth-aware)

Máy móc không chỉ cần biết có vật thể, mà cần biết vật thể ở đâu trong không gian. -

Từ ghi nhận sang hiểu ngữ cảnh (Context-aware)

Camera không chỉ phát hiện người, mà phải phân biệt:-

Người đang đi hay đứng yên?

-

Có nguy hiểm không?

-

Có cần can thiệp không?

-

-

Từ cloud-centric sang edge-centric

Quyết định phải diễn ra ngay tại chỗ:-

Robot không thể chờ cloud để tránh va chạm

-

Hệ thống an toàn không thể chậm vài giây

-

Trong bức tranh đó, camera truyền thống RGB bắt đầu lộ giới hạn. Và đây là “đất diễn” của RealSense.

RealSense đại diện cho thế hệ camera “spatial-first”

RealSense không phải là camera theo nghĩa quen thuộc, mà là cảm biến không gian (spatial sensor). Thay vì ưu tiên hình ảnh đẹp cho con người, RealSense ưu tiên dữ liệu hình học cho máy móc.

Cốt lõi công nghệ của RealSense nằm ở:

-

Stereo vision + infrared để đo chiều sâu

-

Pipeline xử lý depth tối ưu cho realtime

-

SDK thiết kế cho robot, AI, automation ngay từ đầu

Nếu đặt trong bối cảnh xu hướng camera tương lai, RealSense phản ánh một triết lý rất rõ:

Camera tồn tại để máy móc hành động đúng trong thế giới vật lý, không phải để con người xem.

Góc nhìn trực diện: vì sao depth camera sẽ trở thành tiêu chuẩn

Ở góc nhìn thực dụng, có một lý do rất đơn giản khiến depth camera ngày càng phổ biến: thế giới là 3D, còn quyết định trong thế giới thật thì không thể dựa trên dữ liệu 2D.

Robot cần:

-

Biết khoảng cách để tránh va chạm

-

Biết hình khối để gắp đồ

-

Biết không gian trống để di chuyển

Hệ thống thông minh trong bán lẻ, y tế, smart city cũng vậy:

-

Đếm người nhưng không xâm phạm riêng tư

-

Phát hiện té ngã, xâm nhập, hành vi bất thường

-

Hoạt động trong điều kiện ánh sáng kém

RealSense giải quyết những bài toán này bằng cách đưa dữ liệu chiều sâu xuống tầng cảm biến, thay vì cố “suy luận” từ ảnh 2D. Đây là hướng đi phù hợp với xu thế AI hiệu quả, ít dữ liệu hơn nhưng đúng loại dữ liệu.

Góc nhìn đối lập: camera càng thông minh, hệ thống càng phức tạp

Tuy nhiên, nếu nhìn từ góc độ phản biện, xu hướng camera thông minh – trong đó có RealSense – cũng đặt ra những thách thức không nhỏ.

Thứ nhất, camera không còn là phần cứng độc lập.

Giá trị của RealSense không nằm ở thiết bị, mà nằm ở:

-

Thuật toán

-

Calibration

-

Tích hợp với robot/AI stack

Điều này đồng nghĩa:

-

Doanh nghiệp không thể chỉ “mua camera về gắn”

-

Năng lực software, AI, system integration trở thành yếu tố sống còn

Thứ hai, depth camera không phải lúc nào cũng là lựa chọn tối ưu.

Trong môi trường:

-

Ngoài trời nắng gắt

-

Khoảng cách rất xa

-

Yêu cầu độ chính xác siêu cao

Các công nghệ khác như LiDAR, radar, hoặc hệ thống 3D công nghiệp vẫn có lợi thế riêng. RealSense đại diện cho “điểm cân bằng”, không phải cực trị.

RealSense trong bức tranh camera + AI tương lai

Nếu tách RealSense ra khỏi sản phẩm cụ thể và nhìn nó như một mảnh ghép công nghệ, ta sẽ thấy nó nằm đúng giao điểm của 4 xu hướng lớn:

-

Physical AI – AI tương tác trực tiếp với thế giới vật lý

-

Edge AI – xử lý tại thiết bị, giảm phụ thuộc cloud

-

Privacy-by-design – hiểu hành vi mà không cần nhận diện cá nhân

-

Modular automation – hệ thống linh hoạt, dễ PoC và scale

Trong bức tranh này, RealSense đóng vai trò như:

-

“Giác quan không gian” cho robot

-

“Lớp cảm nhận” cho hệ thống tự động

-

“Cửa ngõ” để AI bước ra khỏi màn hình

Từ camera đến nền tảng: sự thay đổi về cách doanh nghiệp đầu tư

Một điểm rất quan trọng, thường chỉ thấy rõ ở góc nhìn consultant, là: doanh nghiệp không còn mua camera – họ đầu tư vào năng lực nhận thức của hệ thống.

Khi đó, câu hỏi không còn là:

“Camera này bao nhiêu megapixel?”

Mà trở thành:

-

Camera này giúp hệ thống ra quyết định gì?

-

Có mở rộng được sang use case khác không?

-

Có tạo ra dữ liệu chiến lược dài hạn không?

RealSense thường được chọn không phải vì nó “mạnh nhất”, mà vì nó:

-

Đủ tốt cho nhiều bài toán

-

Linh hoạt cho thử nghiệm

-

Phù hợp với chiến lược AI dài hạn

Góc nhìn sáng tạo: tương lai camera sẽ “biến mất”

Một dự đoán thú vị là: camera trong tương lai sẽ ngày càng ít được nhắc đến.

Không phải vì nó kém quan trọng, mà vì nó hòa tan vào hệ thống.

Giống như:

-

Chúng ta không còn nói “máy có CPU”

-

Mà nói “hệ thống có đủ thông minh không”

Ở thời điểm đó:

-

RealSense không được gọi là camera

-

Mà là một phần của “perception stack”

Những câu hỏi gợi ý để bạn tự quyết định

-

Hệ thống của tôi cần “nhìn” hay cần “hiểu không gian”?

-

Quyết định có cần diễn ra realtime tại edge không?

-

Tôi đang giải một bài toán đơn lẻ hay xây nền tảng AI dài hạn?

-

Đội ngũ của tôi mạnh ở phần cứng hay phần mềm?

-

Chi phí lớn nhất nằm ở thiết bị hay ở việc không hiểu đúng bài toán?

Kết luận

Xu hướng camera trong tương lai không đi theo hướng “độ phân giải cao hơn”, mà đi theo hướng nhận thức sâu hơn. RealSense là một đại diện rất rõ cho xu hướng đó: thực dụng, hướng hệ thống, và đặt máy móc – chứ không phải con người – làm trung tâm.

Trong thế giới mà AI ngày càng bước ra đời thực, câu hỏi không phải là có dùng camera hay không, mà là:

camera của bạn có giúp hệ thống hiểu thế giới đủ tốt để hành động đúng không?